Maske est un logiciel que j’ai réalisé récemment en guise de découverte de la bibliothèque Openframeworks. Donc, à priori par d’intégration particulière dans un spectacle déjà défini mais plutôt une piste intéressante qui pourrait peut être amener des idées. Voici une petite démo (vous trouverez un lien pour télécharger le logiciel en fin de page) :

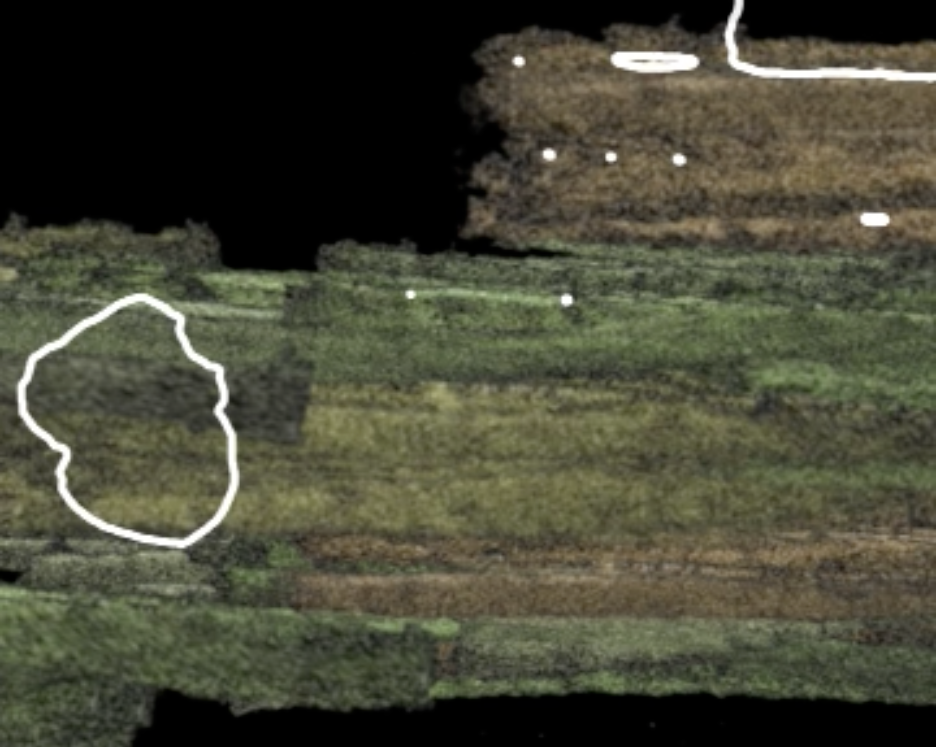

Le principe est simple : le logiciel utilise une caméra, détecte la position des yeux et vient coller sur le visage correspondant un masque. Bien sûr il faut être assez proche de la caméra pour que le logiciel puisse distinguer vos yeux et bien sûr ouvrir grand … vos yeux pour contrôler (tenir ?) le masque. Il y a au choix 5 masques (on passe de l’un à l’autre avec la touche m). Le masque s’adapte à la taille de votre visage et à l’inclinaison de votre tête. On passe du mode plein écran à une fenêtre plus réduite en utilisant successivement les touches f et w.

Je ne vous ferais pas un cours sur l’intérêt et les possibilités de jeu avec un masque, je laisserais ça plutôt à Charlie Windelschmidt de la compagnie Dérézo, qui organise des formations autour de l’usage du masque balinais et a mis en scène le spectacle “Qui ?” (que je vous recommande chaudement), où 4 acteurs utilisent tour à tour le même masque balinais dans 4 solos.

Je vous donnerais plutôt ici mon expériences de cette API et quelques pistes pour la découvrir.

Un mot tout d’abord : Openframeworks est une api qui permet d’économiser un temps de conception conséquent (et un niveau de complexité aussi), et coder en C++ permet de faire des applications puissantes. On peut notamment manipuler la bibliothèque OpenCV en temps réel avec un résultat fluide. Pour ceux qui ne connaissent pas, ça permet de faire de la reconnaissance gestuelle, de formes, de couleurs, … enfin bref de créer une interface invisible, à l’aide d’une caméra, capable de contrôler de manière avancée (beaucoup plus qu’une souris) toutes applications, jeux, …

Le wiki d’Openframeworks vous permet de consulter une grande quantité de documents (exemple, référence, faq, …) ainsi que d’accéder à un forum. Il y a un grand nombre de sources d’applications toutes faites, ou concernant des points spécifiques, qui sont disponibles sur le web. Globalement il est assez simple de construire une application avec les bouts de code que vous trouverez ici ou là.

Il existe aussi des extensions à cette bibliothèque : ce sont les addons (intégrés dans la version FAT d’Openframeworks), des bibliothèques complémentaires vous permettant d’intégrer le midi, l’OSC, Computer vision, …. Maske utilise notamment l’addon OpenCV pour la reconnaissance de l’oeil en temps réel.

Chez l’éditeur O’Reilly on trouve Programming Interactivity de Joshua Noble qui est consacré à l’Arduino, Processing et Openframeworks. Ce livre est une très bonne introduction car il permet une entrée dans la programmation à travers ces trois API (l’Arduino est aussi un programme qui permet de créer les programmes pour la carte Arduino).

Pour ceux qui souhaiteraient une première introduction en français, l’école d’art d’Aix en Provence (par la plume de Douglas Edric Stanley) a mis en ligne quelques pages très instructives sur Openframeworks.

Des workshops sont régulièrement animés par les fondateurs ou la communauté qui développent cette API. Du coté français, le CrasLab en a organisé une en mars dernier.

Pour le reste, il faut néanmoins pointer du doigt une réalité : Openframeworks est une API C++. Il y a énormément de cours, tutoriaux, forums qui vous permettront d’apprendre le C++ pour pas un rond mais moyennant un certain temps. En effet même si L’API Openframeworks simplifie énormément la création d’une fenêtre, le dessin géométrique, l’utilisation d’images, … il faut apprendre les bases du C++ pour faire une application basique avec Openframeworks et se perfectionner en C++ si on veut aller plus loin.

Une version pour OSX de Maske est disponible ici.

Notez bien que l’on change de masque avec la touche m, qu’on passe de plein écran à une petite fenêtre avec les touches f et w, et … ouvrez grand vos yeux.